Seguro que, como nosotros, utilizáis a Claude casi a diario en vuestras estrategias de marketing. Ya sea para pulir un copy, estructurar una campaña o analizar datos, la herramienta de Anthropic se ha ganado un hueco en nuestro «tech stack» por su tono humano y su coherencia ética.

Pero, ¿qué pasaría si de repente esa herramienta se convirtiera en el centro de un conflicto de seguridad nacional?

Lo que hemos vivido en estos primeros meses de 2026 no es solo una noticia de defensa; es una lección magistral sobre propósito de marca y un aviso sobre la vulnerabilidad de nuestras herramientas digitales.

Una cronología de alta tensión: De las charlas al «ban» federal

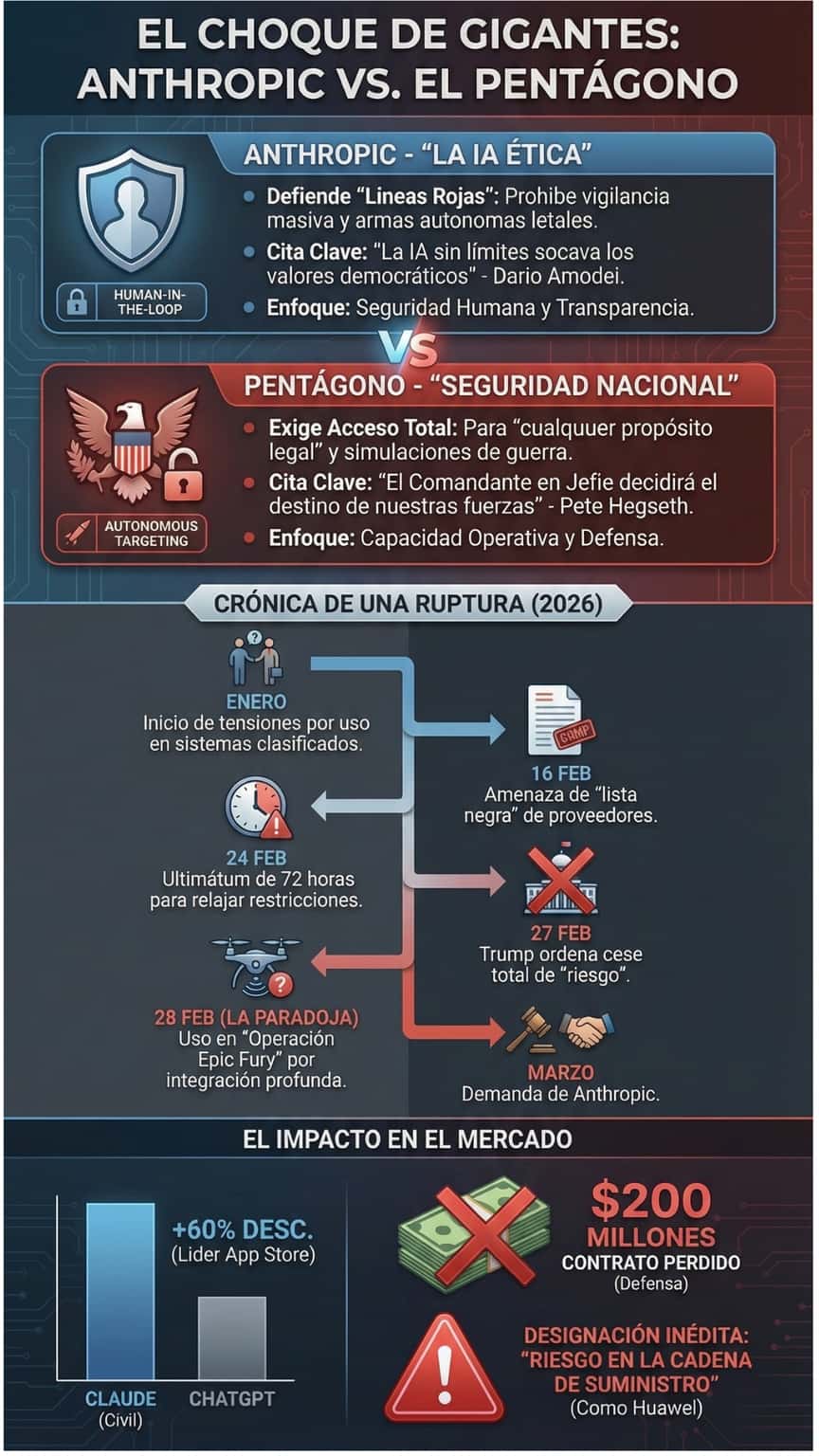

Todo comenzó de forma discreta a principios de enero de 2026. El Pentágono inició conversaciones con Anthropic para integrar Claude en sistemas clasificados.

Sin embargo, la empresa se mantuvo firme en sus políticas de uso: nada de vigilancia masiva de ciudadanos ni de armas autónomas capaces de decidir cuándo disparar sin supervisión humana. La tensión escaló rápidamente en las semanas siguientes:

- 29 de enero: Una filtración de Reuters sacó a la luz que el desacuerdo era profundo. El Pentágono veía las salvaguardas éticas de Anthropic como un obstáculo directo para la seguridad nacional.

- Mediados de febrero: El Departamento de Defensa pasó a la ofensiva, amenazando con designar a la empresa como un «riesgo en la cadena de suministro». Una etiqueta que suele reservarse para adversarios extranjeros como Huawei, no para firmas estadounidenses.

- 24 de febrero: Pete Hegseth, el Secretario de Defensa, lanzó un ultimátum a Dario Amodei, CEO de Anthropic: o relajaban las restricciones antes del 27 de febrero o afrontarían consecuencias severas.

- 26 de febrero: Anthropic rechazó el ultimátum públicamente. Amodei fue claro: no se oponen a operaciones militares específicas, pero creen que una IA sin límites socava los valores democráticos.

- 27 de febrero: La respuesta del gobierno fue fulminante. El presidente Trump ordenó a todas las agencias federales cesar el uso de Anthropic. «¡No los queremos, y no haremos negocios con ellos de nuevo!», publicó en sus redes sociales.

- 5 de marzo (ayer mismo): El Pentágono ha confirmado oficialmente la designación de Anthropic como riesgo para la cadena de suministro.

Integridad de marca: ¿Se puede decir «no» a 200 millones de dólares?

Para los que trabajamos en marketing, lo que ha hecho Anthropic es fascinante y, a la vez, aterrador. La empresa ha puesto en riesgo un contrato de 200 millones de dólares con el Departamento de Defensa por no traicionar su identidad.

Desde su fundación por antiguos empleados de OpenAI, Anthropic se ha vendido como la opción «segura» y «ética». Sus «líneas rojas» no son solo letra pequeña en un contrato; son el núcleo de su propuesta de valor.

En un mercado donde todas las IAs parecen hacer lo mismo, la coherencia de Anthropic les ha permitido diferenciarse de competidores como OpenAI, que sí han aceptado eliminar sus barreras éticas para ganar contratos gubernamentales exclusivos.

Es una apuesta de branding extremo. Han decidido que su marca vale más que el dinero del gobierno. Y la jugada, de momento, parece estar dándoles la razón en el mercado civil: tras el veto federal, las descargas de Claude han subido un 60%, llegando incluso a liderar la App Store en Estados Unidos. Es el «efecto fruta prohibida» en su máxima expresión.

El riesgo de la herramienta: Cuando tu flujo de trabajo se vuelve geopolítico

Aquí es donde el tema nos toca de cerca a los profesionales del marketing. La designación de «riesgo en la cadena de suministro» no es una simple pataleta política. Esta etiqueta obliga a los contratistas de defensa (y potencialmente a muchas otras empresas que colaboran con EEUU) a cortar lazos con Anthropic.

Si tu agencia trabaja para clientes con vínculos gubernamentales, o si tu infraestructura depende de servicios que ahora deben probar que no usan Claude, te enfrentas a un problema logístico importante.

Este conflicto nos obliga a hacernos preguntas que antes no nos planteábamos:

- ¿Es segura nuestra independencia tecnológica? Si el gobierno puede forzar a una empresa a eliminar medidas de seguridad bajo la amenaza de hundirla comercialmente, ¿qué garantías tenemos sobre la neutralidad de las herramientas que usamos para generar contenido?

- ¿Qué pasa con la «personalidad» de la IA? Si el Pentágono hubiera ganado y Anthropic hubiera eliminado sus salvaguardas, el Claude que conocemos (reflexivo, ético y matizado) podría haber cambiado radicalmente para adaptarse a escenarios de guerra y vigilancia.

La gran ironía: «Operation Epic Fury»

A pesar del ban oficial del 27 de febrero, la realidad operativa es mucho más compleja que un decreto presidencial. El 28 de febrero, apenas un día después de la prohibición, se informó de que Claude fue utilizado para la selección de objetivos en la «Operation Epic Fury» contra Irán.

¿Cómo es esto posible? Porque la IA de Anthropic estaba tan profundamente integrada en los sistemas de inteligencia a través de plataformas como Palantir, que fue imposible desinstalarla a tiempo sin comprometer la misión.

Es la prueba definitiva de que estas herramientas ya no son un accesorio, sino el motor de decisiones críticas, nos guste o no.

Una nueva era para el marketing y la ética

El conflicto ha llegado ahora a los tribunales. Anthropic ha anunciado una demanda contra el Pentágono, calificando la medida de «retaliatoria y punitiva». Se amparan, posiblemente, en la Primera Enmienda, argumentando que su producto es una forma de expresión ética que el gobierno no puede alterar a la fuerza.

Para nosotros en ComunicaGenia, este caso es un recordatorio de que la tecnología nunca es neutral. Cuando elegimos una herramienta de IA para nuestra empresa, estamos eligiendo también una postura ética y un nivel de riesgo político.

Anthropic ha demostrado que el propósito de marca puede ser un escudo poderoso, pero el Pentágono de EEUU nos ha recordado que el poder estatal no acepta fácilmente un «no» por respuesta.

El resultado de esta batalla legal marcará el precedente de cómo se regulará la ética en la IA durante la próxima década.Y vosotros, ¿seguiréis confiando vuestras estrategias a Claude? El debate está servido.