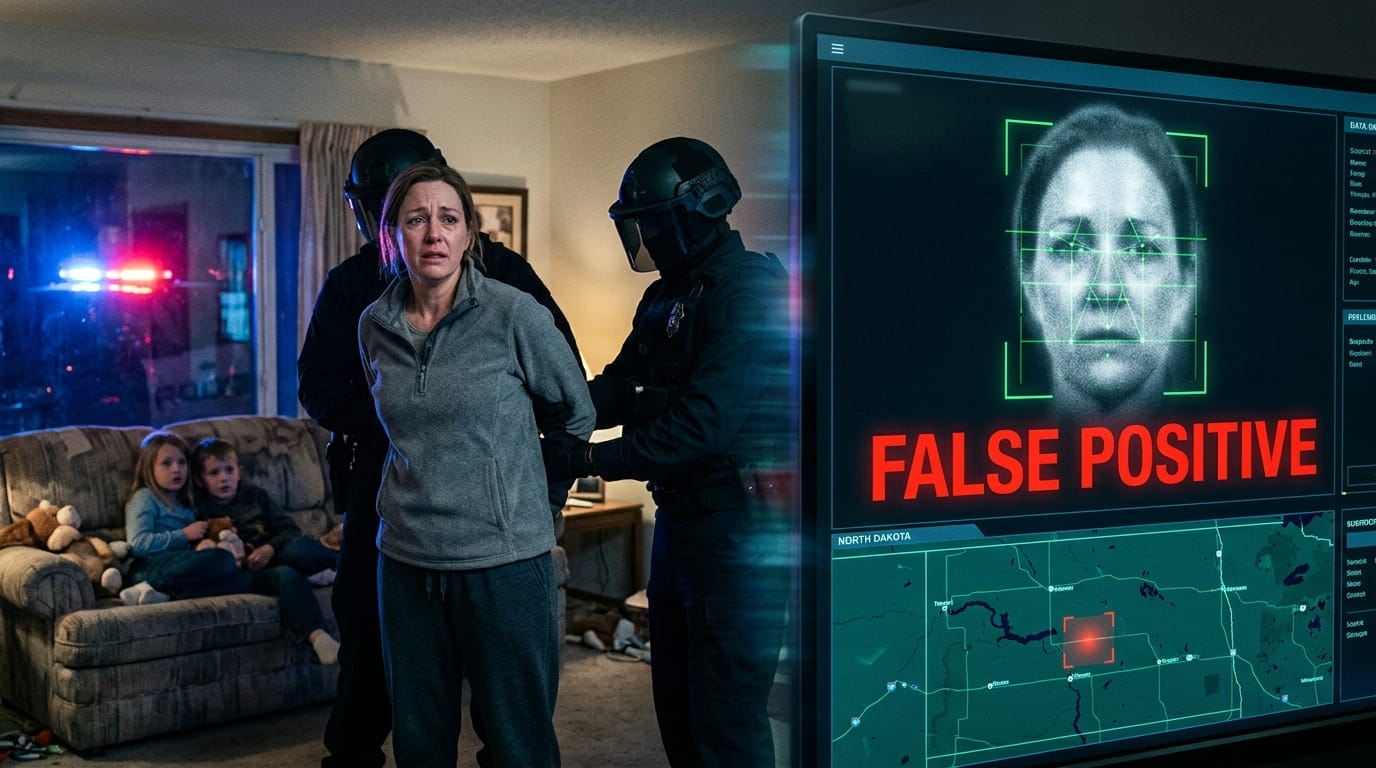

Imagina que estás en casa, cuidando a tus hijos una tarde tranquila, cuando de pronto el estruendo de una unidad táctica rompe tu puerta.Te apuntan con armas, te esposan frente a los niños y te acusan de un crimen cometido en un lugar que jamás has visitado.

Así comenzó la pesadilla de Angela Lipps, una mujer cuya vida fue desmantelada porque un software de reconocimiento facial decidió que su rostro «coincidía» con el de una criminal.

Este no es un guión de ciencia ficción distópica; es una realidad que nos obliga a preguntarnos: ¿estamos delegando nuestra libertad en máquinas que no saben distinguir entre un dato y un ser humano?

Descubre por qué la IA, nuestra mayor promesa de seguridad, puede convertirse en tu peor verdugo si olvidamos la supervisión humana.

El calvario de Angela Lipps: Cuando el algoritmo decide tu destino

Hagamos un ejercicio de imaginación por un momento: De la noche a la mañana, tu identidad es sustituida por una etiqueta de «criminal» en una base de datos. Esto le ocurrió a Angela Lipps en Tennessee.

Sin haber pisado jamás Dakota del Norte, un software de reconocimiento facial analizó las cámaras de un banco y «decidió» que ella era la estafadora que buscaban.

Lo más aterrador no fue el error de la máquina, sino la desidia humana: un agente miró sus redes sociales, notó un parecido en el peinado y, sin una sola prueba física, firmó su arresto. A partir de ahí, la vida de Angela se desmoronó.

Pasó 108 días en una celda, tratada como una fugitiva peligrosa, mientras el sistema ignoraba sus súplicas. Al final, demostrar su inocencia fue muy simple: sus recibos de Uber Eats y el GPS de su móvil confirmaban que estaba a miles de kilómetros del crimen.

Pero para cuando la justicia admitió el error en Nochebuena, Angela ya lo había perdido todo: su casa, su coche y hasta a su perro.

La IA vs las limitaciones humanas

Es natural que te preguntes: si fallan tanto, ¿por qué los departamentos de policía insisten en usar tecnologías de la seguridad? La respuesta está en nuestras limitaciones biológicas.

Como humanos, somos imperfectos: nos cansamos, perdemos la concentración y estamos llenos de sesgos inconscientes. Nuestra memoria es frágil y nuestra capacidad de procesar miles de rostros en segundos es, sencillamente, inexistente.

Ahí es donde la IA aparece como una promesa irresistible. En teoría, un algoritmo no parpadea, no se agota y puede rastrear una «aguja en un pajar» digital en tiempo récord. El problema surge cuando confundimos «eficiencia» con «infalibilidad».

El caso de Angela Lipps nos demuestra que hemos caído en el sesgo de automatización: esa tendencia peligrosa a creer que si lo dice una máquina, debe ser verdad.

Al intentar suplir nuestras carencias con tecnología, hemos creado un sistema donde la vigilancia es total, pero la verificación humana brilla por su ausencia.

Las dos caras de la vigilancia: un equilibrio peligroso

Utilizar IA en seguridad conlleva repercusiones que pueden salvar vidas o, como vimos con Angela, destruirlas. Segmentemos este impacto para entender qué está en juego:

El lado positivo: Eficiencia y protección

- Rapidez de respuesta: La IA permite localizar a personas desaparecidas o sospechosos de terrorismo en cuestión de minutos, algo imposible para un equipo humano.

- Reducción de la fatiga: Evita que errores por cansancio u omisión pasen desapercibidos en centros de control de 24 horas.

El lado oscuro: La erosión de derechos

- Sesgos algorítmicos: Muchos sistemas fallan más con mujeres y minorías étnicas, convirtiéndose en herramientas discriminatorias.

- Inversión de la carga de la prueba: Ya no eres «inocente hasta que se demuestre lo contrario», sino culpable hasta que logres desmentir lo que el software predijo.

Este desequilibrio crea una justicia deshumanizada donde el código pesa más que la realidad.

Seguridad inteligente: la tecnología al servicio del bien común

Para evitar tragedias como la de Angela, la próxima generación de tecnologías debe incluir modelos de «IA explicable», capaces de justificar por qué han tomado una decisión, permitiendo que un humano audite el proceso antes de actuar.

Veremos sistemas de verificación obligatoria que, en lugar de emitir juicios finales, presenten listas de probabilidades que exijan pruebas físicas adicionales para ser validadas.

Además, el desarrollo de algoritmos entrenados con datos diversos y libres de sesgos raciales o de género será fundamental para garantizar la equidad.

Por último, el objetivo es que la tecnología actúe como un copiloto que potencie nuestra capacidad de protección, pero que sea el criterio humano, la empatía y la responsabilidad legal quienes tengan la última palabra sobre la libertad de una persona.

El factor humano: nuestra última línea de defensa

Lo que le ocurrió a Angela Lipps no fue solo un fallo de código, fue una renuncia a nuestra capacidad de cuestionar. La tecnología más avanzada del mundo no sirve de nada si el sentido común se queda fuera de la sala de mandos.

La verdadera seguridad no nace de algoritmos infalibles, sino de instituciones que entiendan que detrás de cada dato hay una vida que puede ser destruida en un clic.

Al final del día, tú y yo debemos exigir que la innovación nunca sea una excusa para la desidia. Porque si permitimos que la máquina sea juez y parte, todos estamos a una actualización de distancia de convertirnos en el próximo error del sistema.