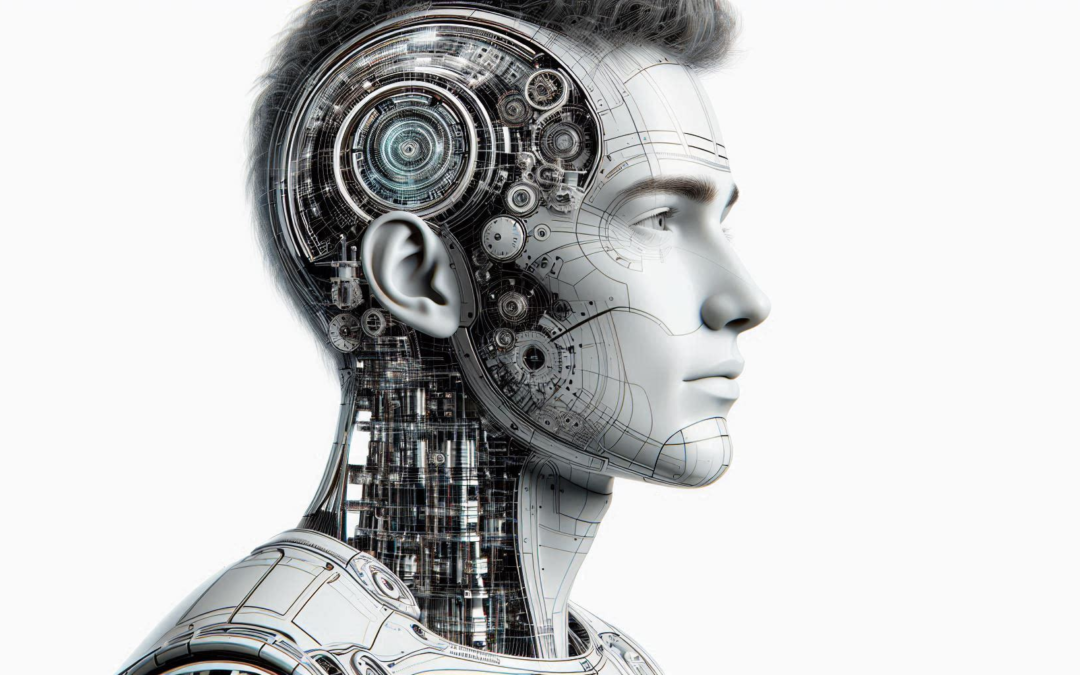

En un mundo donde la inteligencia artificial (IA) y la robótica avanzan, la línea entre lo humano y lo artificial es cada vez más difusa. Esta transformación genera tanto fascinación como temor, en especial cuando las creaciones artificiales se parecen más a nosotros.

Uno de los fenómenos más intrigantes asociados con esta evolución es el «valle inquietante», un concepto que describe la incomodidad que sentimos cuando nos enfrentamos a réplicas humanas que son casi, pero no del todo, perfectas.

Desde robots que cuidan ancianos hasta chatbots que simulan conversaciones humanas, la capacidad de las máquinas para imitar la apariencia y el comportamiento humano ha generado respuestas emocionales diversas.

Conoce las raíces del valle inquietante, sus implicaciones en nuestras interacciones con la IA, y cómo científicos y roboticistas están trabajando para superar estas barreras emocionales.

Origen y definición del valle inquietante

El concepto de «valle inquietante» fue acuñado en 1970 por el robotista japonés Masahiro Mori. En su ensayo, Mori observó que a medida que los robots adquieren una apariencia más humana, nuestra empatía hacia ellos aumenta.

Sin embargo, cuando alcanzan un nivel de similitud cercano, pero no idéntico al de los humanos, hay rechazo. Esto, en un gráfico se ve como un valle que representa la relación entre la semejanza humana de un robot y nuestra respuesta emocional hacia él. De ahí el término «valle inquietante».

Mori postuló que esta reacción surge debido a la detección de imperfecciones y desajustes en las réplicas humanas, lo que nos lleva a percibirlos como seres casi humanos, pero con algo extraño e incorrecto.

Esta sensación de inquietud no se limita solo a robots humanoides; también puede ser desencadenada por representaciones virtuales y voces sintéticas que intentan imitar la realidad humana.

¿A qué se debe el rechazo por imágenes generadas por IA y algunos robots?

El rechazo hacia imágenes generadas por IA y algunos robots se debe en primer lugar al procesamiento configuracional. Esta teoría sugiere que somos en extremo sensibles a la posición y tamaño de los rasgos faciales humanos.

Y es que cuando detectamos desajustes perceptivos, como ojos realistas en una piel poco realista, sentimos una incomodidad debido a esta incongruencia.

Desde una perspectiva evolutiva, estas reacciones podrían vincularse a instintos de supervivencia. El desajuste perceptivo puede ser interpretado como una señal de enfermedad o amenaza, lo que activa una respuesta de asco para evitar posibles fuentes de contagio.

Además, la teoría de la selección de pareja sugiere que percibimos a estos seres artificiales como malos compañeros debido a sus imperfecciones, lo que refuerza nuestra aversión hacia ellos.

Otra explicación es la disonancia cognitiva que experimentamos al asignar cualidades humanas a entidades no humanas.

Cuando interactuamos con agentes artificiales que parecen humanos, nuestro cerebro enfrenta una confusión sobre cómo tratarlos y qué esperar de ellos, lo que provoca una sensación de inquietud.

¿Este rechazo es innato o aprendido?

El rechazo hacia imágenes generadas por IA y algunos robots es un fenómeno que puede ser tanto innato como aprendido. Por un lado, hay evidencias que sugieren que ciertas reacciones son innatas, producto de nuestra evolución.

Teorías como la del procesamiento configuracional, indican que nuestra capacidad para detectar desajustes en los rasgos faciales humanos es una respuesta innata destinada a protegernos de posibles amenazas o enfermedades.

Por otro lado, el rechazo también puede ser aprendido culturalmente. A lo largo de nuestra vida, estamos expuestos a normas sociales y culturales que influyen en nuestra percepción de lo que es «normal» y «aceptable».

Los medios de comunicación y el cine representan robots como entidades peligrosas, reforzando la idea de que debemos temerles. Estas influencias amplían las respuestas innatas al enfrentar seres artificiales que parecen casi humanos, pero no lo son del todo.

Además, la exposición repetida a tecnologías emergentes puede modificar las respuestas. Por ejemplo, generaciones más jóvenes, que crecen interactuando con tecnologías avanzadas, podrían desarrollar una mayor aceptación hacia estos seres.

Casos de Estudio y Ejemplos Reales

Conoce algunos ejemplos reales donde el valle inquietante tiene presencia:

Geminoid HI-1: El androide inquietante

Uno de los casos más emblemáticos del valle inquietante es el desarrollo de los robots humanoides Geminoid. El robotista Hiroshi Ishiguro creó un androide que es casi una réplica exacta de sí mismo, llamado Geminoid HI-1.

Aunque visualmente impresionante, el robot provocó reacciones de incomodidad en muchos espectadores debido a su apariencia casi humana pero ligeramente imperfecta.

Sophia: La robot social

Otro ejemplo notable es el del robot Sophia, desarrollado por Hanson Robotics. Sophia ha sido diseñada para interactuar de manera social con los humanos, ya que tiene una apariencia y expresiones faciales realistas.

A pesar de sus capacidades avanzadas, muchas personas encuentran inquietante su aspecto y comportamiento, especialmente cuando sus expresiones faciales no coinciden perfectamente con su discurso o cuando sus movimientos parecen mecánicos.

“The Polar Express»: El valle inquietante en el cine

En el ámbito del entretenimiento, la película «The Polar Express» (2004) de Robert Zemeckis es un estudio de caso en el uso de CGI (imágenes generadas por computadora).

Aunque la película intentaba crear personajes humanos realistas, muchos espectadores encontraron a los personajes inquietantes debido a sus ojos vidriosos y expresiones faciales poco naturales, ejemplificando el efecto del valle inquietante en la animación.

Impacto del valle inquietante en el desarrollo de IAs

El valle inquietante presenta desafíos en el desarrollo de inteligencias artificiales (IAs), especialmente aquellas que son diseñadas para interactuar con humanos de manera cotidiana.

Desarrolladores y diseñadores de IAs deben equilibrar el realismo con la necesidad de evitar que las máquinas se vuelvan inquietantes para los usuarios. Este fenómeno puede frenar la adopción de tecnologías avanzadas y limitar su aceptación en entornos donde haya interacción humana.

El esfuerzo por superar el valle inquietante ha llevado a la creación de diseños más estilizados y menos realistas, priorizando la funcionalidad y la eficiencia sobre la apariencia humana perfecta.

Además, ha impulsado investigaciones en áreas como la psicología y la neurociencia para entender mejor las reacciones humanas y ajustar el diseño de IAs en consecuencia.

Por lo tanto, el objetivo es desarrollar IAs que no solo sean útiles, sino también aceptables para la mayoría de los usuarios, facilitando su integración en la vida diaria.